|

L'image est tirée du blogue "Reading infinite jest" en ligne : http://chloereadinginfinitejest.blogspot.com/2010/04/amusing-ourselves-to-death.html, page consultée le 18 janvier 2021.

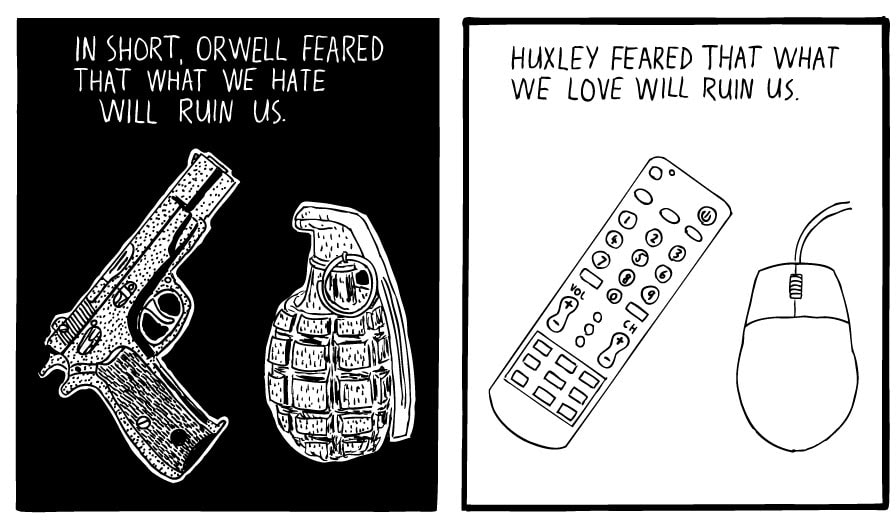

J’entre dans 2021 plus que jamais devant des écrans. J’imagine que c’est le cas pour plusieurs d’entre nous. L’isolement, les propos concernant la pandémie et les tensions politiques donnent l’impression qu’une partie de la population est devenue complètement folle. Ici les médias sociaux font figure de Far West parce que la législation est défaillante pour baliser les contenus et les interactions. C'est la loi du chacun pour soi dans l'univers des géants du web. On peut remercier Donald Trump pour une chose : sa sottise va faire en sorte que les plateformes de médias sociaux vont se doter d'un cadre. Mais qui balise vraiment les médias sociaux et les plateformes ? Les intérêts de quelques corporations et les algorithmes. Je vais donc prendre du temps ici pour exposer quelques considérations sur "les programmes qui font la gestion des fils d'actualité et des recommandations aux internautes". Alors que nous avons de formidables outils de communications sous la main, nos sociétés semblent perdre le niveau de conscience nécessaire à un bon fonctionnement. C’est dommage, parce que la pandémie est vraiment un petit défi comparativement aux bouleversements écologiques à l’horizon. L’année 2020 est possiblement la plus chaude jamais enregistrée dans l’histoire[1]. La nécessité d’une conscience environnementale et d’une sensibilité pour les autres sont des qualités urgentes et pourtant on garde l’impression qu’une partie de la population délire complètement en ligne. Grâce à des lectures, des recommandations de deux étudiantes (Sab et Ari) et des documentaires, je crois fournir ici une partie de la réponse au délire ambiant. Au moment d’écrire quelques lignes, je constate que les robots-influenceurs sont à quelques pas et que nous avons peine à comprendre collectivement comment les médias sociaux changent notre rapport au monde. Je vis dans un monde où les influenceurs générés par ordinateur sont en montée : https://ici.radio-canada.ca/nouvelle/1759939/popularite-influenceur-generes-par-ordinateur-explose-pandemie « Une baleine vaut plus morte pour sa peau, sa graisse et sa viande que vivante. Un arbre vaut plus abattu et découpé en planche que vivant et en croissance. Un individu vaut plus distrait et engagé par les algorithmes que libre et empathique ». Les mots ne sont pas les miens, ils sont ceux de Tristan Harris – Un ancien employé de chez Google qui s’implique présentement activement pour la protection des données personnelles et la prise de conscience face aux algorithmes. Les algorithmes travaillent présentement à ceci : te choquer contre une partie de la population (qui te semble idiote) et te convaincre que ton opinion est bonne et fondée. Il y a également le petit quelque chose de plus : t’extraire le plus de données, les stocker, en faire la compilation pour dresser un profil d’utilisateur. Et ensuite ? Te garder le plus longtemps possible devant ton écran sur la plateforme en te proposant plus de liens. Et les gouvernements sont d’une lenteur incroyable sur cette question. L’algorithme étudie les utilisateurs, les données sont stockées depuis des années avec le consentement rapide des utilisateurs et aucun réel encadrement gouvernemental. Chaque clic est compilé, le temps passé devant chaque page est calculé et la succession des liens suivis est méticuleusement décortiquée. Le modèle d’affaires récompense l’attention donnée à un contenu : ce qui gagne l’attention et la course aux clics. Pas la pertinence, pas la validité scientifique, pas la qualité, certainement pas l’humanité et la gentillesse. Pendant ce temps, des intéressés embrigadent peu à peu une partie de la population en cultivant des réflexes sectaires Sur la censure et l’attention C’est une forme de censure difficile à comprendre: plutôt que d’interdire des propos (et ainsi attirer l’attention sur les propos en question) on permet tous les contenus, tout le monde parle en même temps (ou cri en même temps) et finalement on n’entend plus rien. Ceci pour moi explique partiellement le formidable niveau d’inconscience qui frappe présentement l’espace public. La montée des influenceurs et des « experts de Youtube » qui alimentent les gens les plus fragiles avec des théories du complot. L’exemple est intéressant : les gens ont le réflexe de ralentir pour observer les accidents routiers. Un réflexe de voyeurisme, pour comprendre ce qui se passe, par curiosité perverse. Notre « vieux cerveau » est exposé à des outils du futur. Si Internet est une autoroute, alors les algorithmes vont croire que nos préférences vont vers les accidents routiers. L’algorithme n’est pas moral, il évalue tout simplement ce à quoi l’utilisateur donne son attention. Donc si les algorithmes étaient responsables de la gestion routière ils croiraient que ce que les gens veulent ce sont des accidents routiers. La nature humaine étant ce qu’elle est : pas mauvaise, mais aisément attirée vers le malheur des autres quand elle n’est pas disciplinée. L’algorithme fait donc la déduction suivante : les contenus les plus populaires sont donc l’équivalent des « accidents routiers ». Pour fonctionner de manière optimale, les algorithmes créés des « profils d’utilisateurs » (ce que Tristan Harris appelle une poupée vaudou) élaborés sur mesure pour les utilisateurs. Il y a de fortes chances que les gens dans les mêmes tranches d’âge, habitants dans les mêmes lieux, sous le même régime politique auront des intérêts similaires. Tristan Harris est très critique de l’asymétrie de pouvoir entre l’utilisateur (et son cerveau ancestral) et les algorithmes (l’équivalent de superordinateurs qui sont capables d’analyser et de prédire notre attention). À titre d’exemple : 75% des visionnements sur Youtube proviennent des recommandations de l’algorithme. L’erreur que l’on fait tous ? De croire que l’on est meilleur que les autres, que l’on garde une capacité d’autocontrôle et de discernement du vrai et du faux. Comme dans une secte : de la capture de l’attention jusqu’au génocide La secte contrôle ton environnement social, te dispense la vérité, te répète de mille façons les mêmes choses, te soumet à l’autorité morale d’une ou d’une poignée de figures emblématiques, te fait vivre dans un univers symbolique interne (par la langue et les images) qui est autoréférentiel. La plupart des sectes rejettent également les autres groupes du monde extérieur qui « dorment » ou « sont dangereux ». Au Myanmar (ancienne Birmanie), la population locale navigue par l’entremise de « freebasic » qui fait en sorte que le fournisseur internet te permet d’avoir gratuitement Facebook tandis que les autres médias sont payants. Donc Facebook devient l’internet dans ce pays pour pratiquement toute la population. Une minorité musulmane a vécu un génocide à cause du gouvernement autoritaire local par l’entremise de Facebook qui répandait des fausses informations sur cette minorité. Le gouvernement a donc sciemment exploité les algorithmes et les réflexes sectaires pour conduire la population à des crimes de guerre. C’est un exemple extrême et malheureusement réel de ce que peut faire une bulle artificielle créée par les algorithmes et des acteurs mal intentionnés. Quand ce n’est pas la secte, c’est l’accident de la route Comment les superordinateurs qui gèrent les algorithmes fonctionnent est qu’ils fournissent des recommandations basées sur chaque clic, chaque minute passée et chaque interaction en ligne. Le programme fait ensuite la recommandation d’un point de départ qui se trouve être ton fil d’actualité ou tes recommandations Youtube. L’ exemple donné par Tristan Harris dans l’épisode du Podcast de Joe Rogan est à glacer le sang : Une jeune mère s’inscrit sur un groupe Facebook de mères concernées par la santé des bébés --- dans les recommandations se trouve la populaire communauté antivaccin également très concernée par la santé des enfants ---- Une fois sur les liens antivaccins (juste pour voir ou explorer) les liens proposés seront ---- l’épandage de Covid sur Montréal par avion et les célébrités qui ne croient pas au Covid, les antimasques, etc. Le pire attire l’attention : les humiliations, les blessures, la corruption, les conflits, etc. Le pire est que l’algorithme veut t’engager avec ce qui te fait plaisir (en te donnant raison) et également avec ce qui t’horripile (amour et haine) pour prouver que les autres ont tort. Au final, il est relativement facile de croire des généralisations hâtives sur des groupes auxquels on n’appartient pas. L’inverse est vrai : les gens de « l’autre côté de Facebook » croient la même chose sur notre groupe. Peu à peu on glisse et on se détache de la réalité. Peu importe ton point de départ Parti de droite populiste --- page qui méprise le ou les partis de gauche --- Un parti comme le Front national (extrême droite française) --- page de mépris des musulmans --- extrême-droite européenne avec des pages de haine anti immigration --- Théories du complot pédosataniques pour noyer la majorité consciente dans les vagues migratoires inconscientes. Parti de gauche --- blogueur qui dénonce les dérives de la droite --- groupe anarchiste ou communiste --- soutien unilatéral à toutes les formes d’immigration et la désobéissance civile --- théories du complot de la droite composée du 1% qui contrôle l’économie est les médias --- Théories complotistes pédosataniques d’un peuple reptilien qui vit dans le sous-sol terrestre. Le débat n’est donc pas « gauche-droite » mais un mélange entre la qualité des informations consommées, la quantité de données extraites de l’utilisateur, notre capacité collective à faire la différence entre le vrai et le faux et la compréhension de ce que sont les algorithmes. Chaque nouveau médium porte un pouvoir autodestructeur intense en lui. Nos seuls remparts sont l’éducation et l’intervention gouvernementale. En attendant l’éveil des gouvernements, je vais continuer de dispenser des cours de mettre en garde et recommander quelques lectures. Une partie des propos contenus dans ce billet ne reflètent pas entièrement mon opinion (certains passages de mon texte sont très alarmistes) et sont plutôt le reflet des considérations présentées dans les sources suivantes : Tristan Harris – Travaillait chez Google et est très critique des développements récents des médias sociaux. À voir : The social dilemma, 2020, 1h34, Réalisateur Jeff Orlowski. En français « Derrière nos écrans de fumée ». Disponible sur Netflix. Note : C'est un documentaire-dramatique qui utilise des acteurs et de la musique dramatique pour renforcer le message. Les commentaires sont très pessimistes. Je crois qu'il est à voir pour lancer une discussion et non pas en faire un dogme. Je recommande également « The great hack » un documentaire sur l’affaire Cambridge Analytica. À écouter : Épisode 1558 – Tristan Harris, Joe Rogan Podcast (donc la balado de Joe Rogan . Tous les outils de recherche peuvent te conduire vers cette entrevue) À lire : "Se distraire à en mourir" de Neil Postman. Un classique pour comprendre l'évolution de la culture et des médias. POSTMAN, NEIL, Se distraire à en mourir, éditions pluriel, 2017 [1985], 254 pages [1] Ici : https://www.ledevoir.com/societe/environnement/592958/l-annee-2020-a-ete-la-plus-chaude-enregistree-dans-le-monde

2 Commentaires

|

AuteurJ'essaie d'inspirer chaque personne que je rencontre. À défaut, je la faire rire ou je l'ignore. Je suis professeur de sociologie au Cégep de Granby depuis quelques années. J'habite également mon corps et ne vois aucune contradiction à combiner la force de l'esprit et celle du corps. Dans le passé, j'ai occupé la fonction de représentant des organismes communautaires de l'Estrie. Mon objectif est de favoriser une prise de conscience par l'entremise de ma discipline et de mes expériences. Archives

Juin 2024

|

Flux RSS

Flux RSS